네이버, 카카오, LG 등 한국어 모델 초거대 AI 개발

[한스경제=김재훈 기자] 대규모 데이터를 학습해 스스로 사고하고 판단하는 ‘초거대 인공지능(AI)’가 글로벌 빅텍크기업들의 미래 신사업으로 떠오르고 있다. 구글, 화웨이 등 글로벌 빅텍크기업들은 초거대 AI 개발에 뛰어들며 미래 글로벌 AI 주도권 선점에 나서고 있다.

네이버, 카카오 등 국내 대표 빅텍크기업들도 한국어 모델 초거대 AI를 공개하며 미국과 중국이 선두 경쟁을 벌이는 초거대 AI 시장에서 글로벌 AI 주권 확보는 물론 더 나아가 초거대 AI 분야 기술 리더를 노리고 있다.

최초 모델 ‘GPT-3’ 이후 글로벌 초거대 AI 경쟁 본격화

초거대 AI는 파라미터(매개변수) 규모가 커질수록 성능이 향상된다. 1750억개 파라미터로 구성된 세계 최초 초거대 AI ‘GPT-3’가 출시된 이후 약 1년 만에 초거대 AI 성능은 약 10배 향상됐다.

일론 머스크가 설립한 미국 AI 전문기업 ‘오픈AI’가 개발한 GPT-3는 인간 같은 자연스러운 대화와 스스로 판단하고 행동하는 모습을 보이며 글로벌 IT업계에 큰 주목을 받았다. 이후 구글, 화웨이, 마이크로소프트(MS) 등 글로벌 빅테크기업은 물론 ‘알파고’를 개발한 딥마인드까지 뛰어들며 초거대 AI 개발 경쟁이 시작됐다.

구글은 올해 1월 1조6000억 파라미터의 ‘스위치 트랜스포머(Switch Transformer)’를 시작으로 5월 진행한 개발자회의에서 초거대 AI '람다'를 공개하고 AI 기능을 크게 강화한 서비스를 대거 발표했다. 순다르 피차이 구글 CEO는 “람다는 미리 정의된 답변을 학습하지 않아 자연스러운 대화를 할 수 있다”며 “어떤 대화도 수행할 수 있다”고 말했다.

MS와 엔비디아는 10월 5300억 파라미터 규모 ‘메가트론(Megatron)’을 공개했으며 딥마인드는 지난 8일 2800억 파라미터의 ‘고퍼(Gopher)’를 공개해 경쟁에 뛰어들었다.

중국도 초거대 AI 개발에 한창이며 미국과 양강 체제를 굳건히 하고 있다. 화웨이는 지난 4월 파라미터 2000억개의 초거대 AI '판구 알파'를 공개했다.

중국 비영리 연구기관 ‘베이징인공지능연구원’은 1조7500억 파라미터의 ‘우다오 2.0’을 출시하며 조단위 파라미터 초거대 AI 경쟁에 뛰어들었다.

한국어 초거대 AI 등장…AI 기술 종속 막는다

국내 빅텍크기업들은 외국산 AI 플랫폼 기술 종속을 막고 글로벌 AI 주권 사수와 글로벌 기술 리더 지위 확보를 위해 한국어 초거대 AI 모델을 잇달아 출시하고 있다.

네이버는 지난 5월 국내 기업 최초 초거대 AI ‘하이퍼클로바(HyperCLOVA)’를 공개하고 국내에서의 AI 퍼스트무버를 넘어 글로벌 AI 기술 리더로 발돋움하겠다는 계획을 밝혔다.

정석근 네이버 CLOVA CIC 대표는 “글로벌 기술 대기업들은 대형 AI 모델이 가져올 파괴적 혁신에 대한 기대로 투자를 가속화하고 있다”며 “한국의 AI 기술이 글로벌 플랫폼에 종속되지 않기 위해서는 이미 공개된 기술을 활용하고 따라잡는 수준에 그칠 수 없다고 판단했다”고 밝혔다.

하이퍼클로바는 GPT-3를 뛰어넘는 2040억개 파라미터 규모로 개발됐다. 또한 한국어 데이터를 6500배 이상 학습해 현재 전 세계에서 가장 큰 한국어 초거대 언어모델이다. 이는 영어 중심의 글로벌 AI 모델과 달리 한국어에 최적화한 언어모델을 개발함으로써 AI 주권을 확보한다는 의미도 있다.

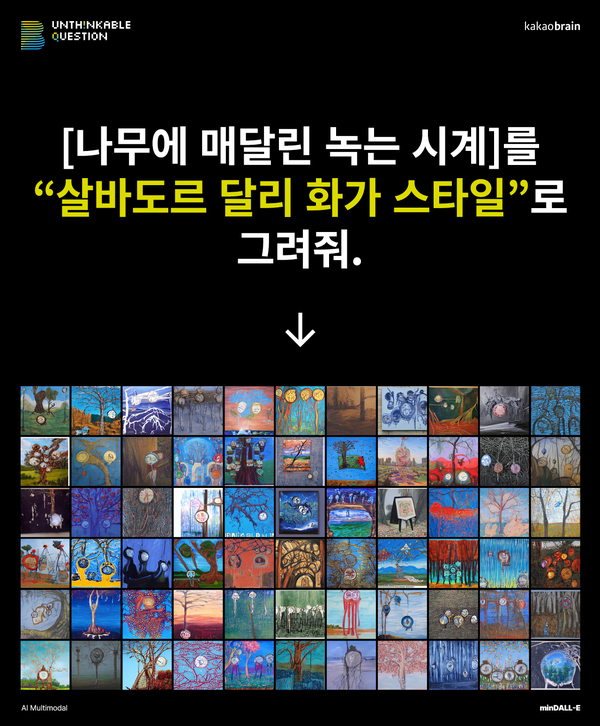

카카오브레인은 지난 15일 초거대 AI 멀티모달 ‘minDALL-E’를 세계 최대 오픈소스 커뮤니티 깃허브(github)에 공개했다. minDALL-E는 이용자가 텍스트로 명령어를 입력하면 실시간으로 원하는 이미지를 만들어주는 이미지 생성 모델이다. 오픈 AI의 'DALL-E'를 누구나 접근하기 쉽게 작은 사이즈 모델로 만든 것으로 1400만장의 텍스트와 이미지 세트를 사전 학습했다.

카카오브레인은 지난달에는 한국어 특화 AI 언어모델 ‘KoGPT’를 선보였다. 현재 성능 고도화를 위해 구글에서 개발한 텐서 처리 장치인 ‘구글 TPU’를 활용해 1엑사 플롭스(초당 100경 연산처리)를 뛰어넘는 국내 최대 규모 딥러닝 슈퍼컴퓨팅 인프라를 도입해 연구 효율을 높였다. 여기에 KoGPT의 파라미터를 60억개에서 300억개까지 5배 늘려 이전보다 더 정확하게 명령을 이행할 수 있도록 만들었다.

김일두 카카오브레인 대표는 20일 기자간담회에서 “무작정 파라미터 등 사이즈를 키우기보단 적은 파라미터에도 동등한 수준의 성능을 낼 수 있게 개발했다”며 “향후 교육, 헬스케어 등 다양한 분야에 적용해 글로벌 1등을 목표로 프로젝트를 진행 중이다”고 밝혔다.

LG AI연구원도 지난 14일 3000억 파라미터 규모 ‘엑사원(EXAONE)’을 공개했으며 1조 파라미터 이상으로 늘리겠다고 밝혔다. 엑사원은 100년치 화학 문헌 2000만건을 학습해 신소재·신물질을 발굴하고 해외 문헌을 탐색해야 하는 만큼 한국어·영어를 모두 학습한 이중 언어 모델로 개발됐다.

김재훈 기자 rlqm93@sporbiz.co.kr