메타·구글, AI로 청소년 인증하고 보호...유해 콘텐츠 차단 도와

[한스경제=박정현 기자] 불법 성범죄 콘텐츠를 급격히 확산시킨 인공지능(AI) 기술이 뒤늦게 청소년들을 보호하기 위한 수단으로 재조명되면서 속속 도입되고 있다.

18일 업계에 따르면 인스타그램 등 미국 소셜네트워크서비스(SNS) 기업들이 AI를 활용한 청소년 보호 대책 세우기에 나섰다.

인스타그램은 11일 서울 사옥에서 기자간담회를 열고 14세 이상 18세 이하의 청소년들에게 적용되는 새로운 10대 보호 계정을 소개했다.

AI를 기반으로 한 '성인 분류기'라는 소프트웨어가 사용자의 프로필, 팔로워 목록, 상호작용하는 콘텐츠을 분석해 사용자를 18세 이상 또는 미만으로 분류할 예정이다.

청소년 계정으로 분류되면 '아무나' 청소년에게 접근할 수 없게 된다. 계정은 비활성으로 전환돼 부모의 동의 없이는 활성화가 불가능하다. 뿐만 아니라 청소년이 계정을 팔로우하거나 이전에 대화 기록이 있어야지만 청소년에게 메시지를 보낼 수 있다.

구글도 12일 AI를 이용해 이용자가 자사의 특정콘텐츠를 이용하기에 적절한 나이인지 식별하는 시스템을 적용한다고 밝혔다.

수십억 명의 이용자를 보유한 구글은 18세 미만에게 일부 서비스를 제한하고 있으나, 청소년들이 연령 제한 자료에 엑세스하기 위해 우회 방법을 찾는 경우가 많아 단속이 쉽지 않았다.

젠 피츠패트릭 구글 코어 테크놀로지 팀 수석부사장은 "이 모델은 이용자 나이를 추정해 보호 기능을 적용하고 연령에 맞는 경험을 제공하도록 도울 것"이라고 설명했다.

이런 AI 기반 청소년 보호 방안은 온라인 플랫폼이 미성년자에 대한 보호 조치를 강화해야 한다는 압박이 커지는 가운데 나왔다.

오픈AI의 챗GPT가 AI의 대중화를 이끌었던 2022년 이후 전세계에서 AI를 활용한 디지털 성범죄가 급격히 증가하기 시작했다. AI에 대한 접근성이 높아져 일반인도 AI를 활용한 성범죄물을 만들 수 있게 되면서 관련 범죄가 속출한 것이다.

한국여성인권진흥원 디지털성범죄피해자지원센터(디싱센터)에 따르면 지난해 디지털 성범죄 피해자는 전년(8983명) 대비 14.7% 늘어 최초로 1만명(1만305명)을 넘어섰다. 피해 유형을 보면 동의 없이 신체를 찍은 불법 촬영물보다 AI 기반 이미지 합성 기술인 딥페이크로 인한 피해가 6년새 20배 폭증했다.

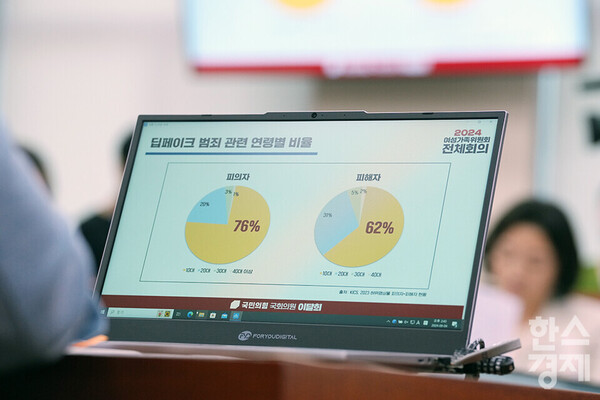

특히 청소년 피가해자 비율이 높다. 경찰청에 따르면 허위영상물 피의자 중 75.8%가 10대, 피해자 중에서도 10대가 62%로 밝혀졌다.

지난해 국내에서는 텔레그램을 비롯한 소셜네트워크서비스(SNS)에서 이 같은 딥페이크 음란물을 생성·유포하는 것으로 의심되는 단체 대화방이 대규모로 발견됐는데, 가해자들은 인스타그램 등 SNS에 올라온 피해자들의 사진을 무단으로 저장해 범행에 활용한 것으로 알려졌다.

메타나 구글 등 빅테크들의 AI를 통해 청소년들의 계정을 보호하고, 유해 콘텐츠를 차단하면서 청소년과 디지털 성범죄의 접촉면은 줄어들 것으로 보인다.

하지만 잠재적 피해자인 청소년들의 활동을 제한하는 방식은 수동적인 대응이 아니냐는 지적도 나온다.

한국의 경우 정부가 지난해 11월 '딥페이크 성범죄 대응 강화 방안'을 발표하며 국내외 플랫폼 사업자의 의무를 강화했다. 텔레그램 등 국내 사업소가 없는 해외기반 플랫폼도 본격 규제하기 시작한 것이다. 이를 위해 AI 기반 자동 식별·채증 시스템이 해외 SNS 모니터링을 집중 실시하게 됐다.

박정현 기자 awldp219@sporbiz.co.kr